Изучение машинного обучения становится все более популярным, и одной из ключевых технологий, которую нужно освоить, является использование графических процессоров (GPU). В современных компьютерах видеокарты не только отвечают за обработку видео и игр, но также предоставляют значительное ускорение для вычислений, связанных с машинным обучением.

Python является одним из самых популярных языков программирования для работы с машинным обучением, и он также предоставляет удобные инструменты для работы с графическими процессорами. Освоение этих инструментов позволяет значительно ускорить процесс обучения моделей и повысить их эффективность.

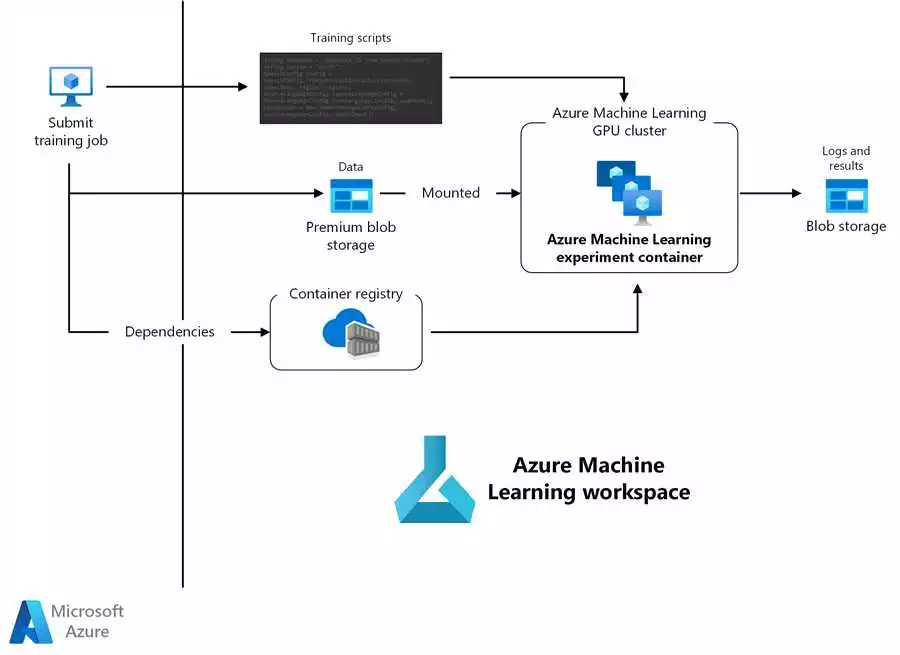

Как использовать графические процессоры для машинного обучения с помощью Python? Существует несколько библиотек, таких как TensorFlow, PyTorch и Keras, которые предоставляют инструменты для работы с GPU. Они позволяют легко распределить вычисления по нескольким графическим процессорам, что значительно ускоряет обучение моделей на больших данных.

Python с его простым и понятным синтаксисом позволяет легко освоить работу с графическими процессорами для машинного обучения. В этой статье мы рассмотрим основные принципы использования GPU с помощью Python и узнаем, как эффективно использовать их для обучения моделей машинного обучения.

Python для машинного обучения: эффективное использование графических процессоров

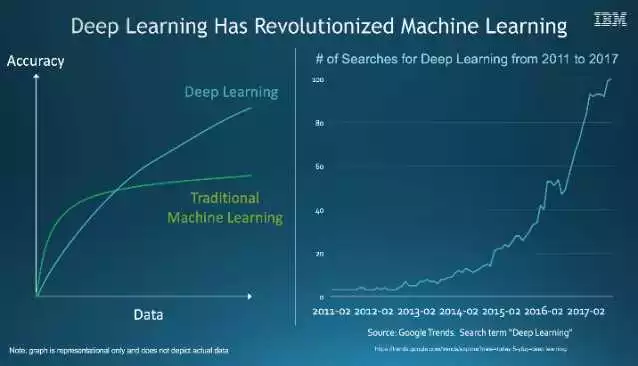

В машинном обучении, эффективное использование графических процессоров (GPU) играет важную роль. Традиционно, машинное обучение выполняется на центральном процессоре (CPU), но с развитием графических процессоров и их высокого параллелизма, использование GPU стало незаменимым инструментом для обучения глубоких нейронных сетей и других сложных моделей.

Python является одним из самых популярных языков программирования для машинного обучения. Он предоставляет широкий набор инструментов и библиотек, которые позволяют работать с графическими процессорами. Пользователи Python могут использовать библиотеки, такие как TensorFlow, PyTorch и Keras, для обучения моделей с использованием GPU.

Изучение основ использования графических процессоров и их интеграция с Python может быть сложным процессом. Однако, с правильными ресурсами и подходом, можно освоить работу с графическими процессорами в Python для эффективного использования GPU в машинном обучении.

Для начала изучения использования графических процессоров в Python, можно ознакомиться с документацией по конкретным библиотекам, таким как TensorFlow или PyTorch. Они предлагают обширные руководства и примеры кода для использования GPU в машинном обучении. Также можно найти онлайн-курсы и видеоуроки, которые помогут освоить работу с графическими процессорами в Python.

При использовании графических процессоров в Python для машинного обучения, необходимо учитывать характеристики и ограничения видеокарт. Не все видеокарты поддерживают высокую производительность при обработке машинного обучения. Поэтому перед использованием GPU, необходимо проверить совместимость видеокарты с выбранными библиотеками и моделями машинного обучения.

Использование графических процессоров с Python для машинного обучения имеет множество преимуществ. GPU позволяют ускорить обучение моделей и сократить время обработки данных. Они также позволяют работать с более сложными моделями, которые требуют большого количества вычислений. Для эффективного использования GPU в Python, необходимо следить за оптимизацией алгоритмов и конфигурацией графических процессоров.

Использование графических процессоров в Python для машинного обучения требует изучения и практики. Но благодаря широкому выбору инструментов и ресурсов, можно освоить работу с графическими процессорами и достичь эффективного использования GPU в своих проектах машинного обучения.

Python для машинного обучения

Python — это один из самых популярных языков программирования для машинного обучения. В связи с его простотой и мощными инструментами, многие люди выбирают Python для изучения и дальнейшей работы в области машинного обучения.

Использование графических процессоров (GPU) является важным аспектом при работе с машинным обучением. Графические процессоры обеспечивают более быструю обработку и анализ данных, что позволяет значительно ускорить процесс обучения моделей машинного обучения. Включение поддержки графических процессоров в Python позволяет использовать их ресурсы для ускорения работы с данными.

Для работы с GPU в Python можно использовать такие библиотеки, как TensorFlow, PyTorch и Theano. Эти библиотеки позволяют удобно использовать графические процессоры для обучения моделей машинного обучения.

При освоении Python для машинного обучения полезно изучить работу с графическими процессорами. Настройка и использование GPU позволяют работать с более сложными и объемными задачами, ускоряя процесс обучения моделей.

Изучение графических процессоров и их использование с Python для машинного обучения является ценным навыком. Это позволяет эффективно использовать ресурсы видеокарты для обработки данных и повышения производительности моделей машинного обучения.

Обучение с использованием GPU в Python имеет свои особенности и требует некоторых знаний и навыков. Однако, освоить работу с графическими процессорами в Python доступно для всех желающих, и это поможет вам стать более эффективным специалистом в области машинного обучения.

Питон — идеальный инструмент для работы с графическими процессорами. Он предлагает простой и интуитивно понятный интерфейс для взаимодействия с GPU и позволяет эффективно использовать их при обучении моделей машинного обучения.

Польза машинного обучения в различных сферах жизни

Изучение машинного обучения (ML) и его применение в реальной жизни становятся все более актуальными. Одним из ключевых инструментов для эффективного использования ML являются графические процессоры (GPU) и видеокарты.

Python является одним из наиболее популярных языков программирования для работы с ML. Освоение и использование графических процессоров в Python становится неизбежным шагом для многих разработчиков. Ведь GPU позволяют значительно ускорить процесс обучения и работу моделей машинного обучения.

Процесс машинного обучения включает в себя множество итераций, и использование графических процессоров значительно сокращает время, затрачиваемое на обучение моделей. Видеокарты, оснащенные графическими процессорами, позволяют ускорить выполнение математических операций, которые необходимы для обучения моделей машинного обучения.

Освоение и использование графических процессоров в Python позволяют значительно ускорить работу с большими наборами данных, а также повысить точность и эффективность моделей машинного обучения.

В различных сферах жизни машинное обучение с графическими процессорами находит широкое применение:

- Финансовая сфера: прогнозирование рынка, определение рисков, управление портфелем и другие финансовые аналитические задачи с использованием машинного обучения.

- Медицина: диагностика и обработка медицинских изображений, прогнозирование распространения заболеваний, поиск новых лекарств и т.д.

- Транспорт: оптимизация маршрутов, управление транспортными сетями, прогнозирование аварийности и др.

- Промышленность: автоматизация производственных процессов, оптимизация энергопотребления, управление качеством и т.д.

Использование машинного обучения с графическими процессорами позволяет решать сложные задачи во многих отраслях, прогнозировать и оптимизировать процессы, а также находить новые возможности для развития и повышения эффективности в различных сферах жизни.

Роль Python в машинном обучении

Python — один из самых популярных языков программирования, который широко используется в машинном обучении. Он имеет множество библиотек и инструментов, которые делают его востребованным выбором для работы с графическими процессорами (GPU) в машинном обучении.

Работа с GPU имеет огромное преимущество, так как они способны обрабатывать параллельные задачи гораздо быстрее, чем центральные процессоры (CPU). Python обеспечивает простой и удобный интерфейс для работы с GPU и позволяет использовать его для обучения моделей машинного обучения с помощью графических процессоров.

Изучить работу с GPU в Python необходимо для эффективного использования мощностей видеокарт при обучении моделей машинного обучения. Возможность использовать графические процессоры значительно ускоряет процесс обучения и позволяет обрабатывать большие объемы данных.

Python имеет множество библиотек, специально разработанных для работы с графическими процессорами, таких как TensorFlow, PyTorch, Theano и других. Они предоставляют высокоуровневые абстракции, которые упрощают использование графических процессоров для обучения моделей машинного обучения.

- Python позволяет изучить основы работы с графическими процессорами.

- Освоение использования видеокарт с помощью Python поможет улучшить производительность процесса обучения.

- Графические процессоры позволяют обрабатывать большие объемы данных и ускоряют процесс обучения моделей.

- Python доступен и прост в использовании, что делает его идеальным выбором для работы с графическими процессорами в машинном обучении.

Выводя наши исследования можно сказать, что Python играет важную роль в области машинного обучения, особенно при использовании графических процессоров. Он облегчает работу с видеокартами и позволяет использовать их мощности для обучения моделей машинного обучения, ускоряя процесс обучения и повышая производительность.

Эффективное использование графических процессоров

Изучение и использование графических процессоров (GPU) стало неотъемлемой частью работы в области машинного обучения. Вместе с возрастающей популярностью языка программирования Python, стало возможным эффективно использовать GPU для обучения моделей и работы с графическими данными.

Python является одним из наиболее популярных языков программирования для машинного обучения, и его синтаксис и удобство использования делают его прекрасным выбором для работы с графическими процессорами. Освоение работы с GPU в Python — задача, которую можно легко освоить и использовать в своих проектах.

Для начала работы с графическими процессорами необходимо освоить основы работы с видеокартами и процессорами. Возможности использования GPU в Python могут быть значительными, но требуют некоторых специфических знаний. Несмотря на это, современные библиотеки и инструменты позволяют легко работать с графическими процессорами в Python.

Основным инструментом для работы с графическими процессорами в Python является библиотека TensorFlow. Она позволяет использовать GPU для обучения моделей машинного обучения с помощью высокопроизводительных вычислений. TensorFlow обеспечивает эффективную работу с видеокартами и позволяет использовать их вычислительные возможности для ускорения обучения моделей.

Для использования графических процессоров в Python также существует другие библиотеки, такие как PyCuda и PyOpenCL. Они предоставляют низкоуровневые интерфейсы для работы с графическими процессорами и позволяют более гибко использовать их вычислительные возможности.

Чтобы эффективно использовать графические процессоры в Python для машинного обучения, необходимо изучить основы работы с GPU и овладеть необходимыми инструментами и библиотеками. При правильном использовании графических процессоров в Python можно значительно ускорить обучение моделей и работу с графическими данными.

Преимущества использования графических процессоров

Использование графических процессоров (GPU) в машинном обучении становится все более популярным. Это неудивительно, ведь GPU позволяют ускорить процесс обучения моделей и повысить их производительность. Рассмотрим основные преимущества использования графических процессоров для машинного обучения:

- Ускорение обучения: GPU обладают высокой параллельной вычислительной мощностью, что позволяет значительно ускорить обучение моделей машинного обучения. Вместо последовательной обработки данных, GPU способны обрабатывать множество операций одновременно, что позволяет значительно снизить время обучения.

- Большой объем памяти: Видеокарты обычно имеют больший объем памяти по сравнению с центральными процессорами. Это позволяет работать с большими наборами данных, что существенно упрощает и ускоряет обучение моделей.

- Повышенная производительность: Использование GPU значительно повышает производительность моделей машинного обучения, особенно в случае сложных вычислительных задач. Графические процессоры специально разработаны для работы с большими объемами данных, что становится особенно полезным для обработки графов, изображений и других сложных структур данных.

Использование графических процессоров в Python для машинного обучения требует некоторой предварительной работы. Необходимо освоить инструменты для работы с графическими процессорами, изучить специфические особенности и возможности GPU. Кроме того, для использования графических процессоров в машинном обучении существуют специализированные библиотеки, такие как TensorFlow и PyTorch, которые максимально упрощают и ускоряют процесс работы с GPU.

Использование графических процессоров в машинном обучении открывает новые возможности для разработки искусственного интеллекта. Оно позволяет обрабатывать большие объемы данных и более сложные модели, а также ускоряет обучение и повышает производительность моделей. Использование графических процессоров в Python можно освоить с помощью специальных учебных материалов и практических заданий. С их помощью вы сможете научиться использовать GPU для ускорения процесса обучения моделей машинного обучения.

Инструменты для работы с графическими процессорами в Python

Графические процессоры (GPU) — это мощные устройства, которые широко используются в машинном обучении и обработке графики. В Python существует несколько инструментов, которые позволяют эффективно использовать графические процессоры для обучения моделей и выполнения вычислений.

1. TensorFlow

TensorFlow — это библиотека машинного обучения с открытым исходным кодом, разработанная компанией Google. Она обеспечивает мощные возможности для работы с графическими процессорами, позволяя ускорить выполнение операций над данными. TensorFlow поддерживает использование GPU для обучения нейронных сетей и выполнения вычислений с использованием параллельных алгоритмов.

2. PyTorch

PyTorch — это еще одна популярная библиотека машинного обучения на языке Python. Она также предоставляет возможности для работы с графическими процессорами и разработки нейронных сетей. PyTorch активно использует GPU для обучения моделей и выполнения вычислений, что позволяет значительно ускорить процесс обучения и получить результаты быстрее.

3. CUDA

CUDA (Compute Unified Device Architecture) — это платформа параллельных вычислений, разработанная компанией NVIDIA для работы с их графическими процессорами. CUDA позволяет программистам использовать GPU для выполнения вычислительных задач, включая обработку графики, научные вычисления и машинное обучение. В Python доступна библиотека PyCUDA, которая предоставляет простой интерфейс для работы с CUDA и управления графическими процессорами.

4. Theano

Theano — это еще одна библиотека машинного обучения на языке Python, которая активно использует графические процессоры для выполнения вычислений. Она предоставляет высокоуровневый интерфейс для работы с глубокими нейронными сетями и выполнения различных математических операций. Theano позволяет организовать эффективную работу с GPU и ускорить процесс обучения моделей.

Использование графических процессоров для обучения моделей и выполнения вычислений является важной техникой в машинном обучении. Изучение и освоение инструментов для работы с графическими процессорами в Python поможет ускорить работу, повысить эффективность моделей и достичь лучших результатов.

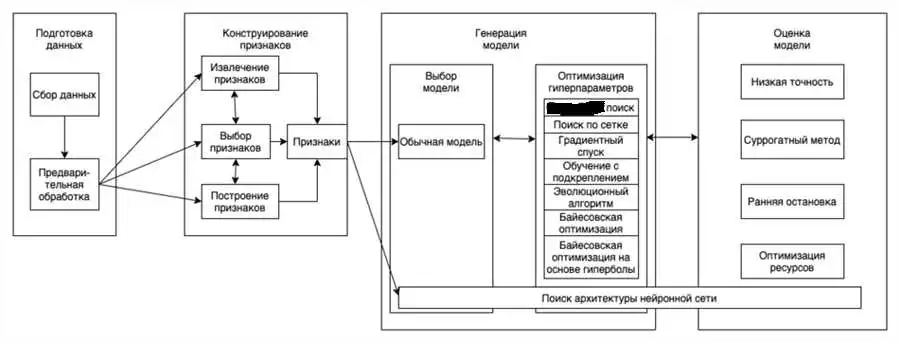

Оптимизация работы с графическими процессорами в Python

Графические процессоры (GPU) предоставляют возможность значительно ускорить вычисления, связанные с машинным обучением. Python как популярный язык программирования также предлагает множество инструментов и библиотек для использования графических процессоров в машинном обучении. Однако, чтобы максимально эффективно использовать GPU для ускорения работы с машинным обучением, необходимо освоить некоторые особенности и оптимизации.

Для начала необходимо изучить работу с графическими процессорами в Python. Большинство пользователей Python для машинного обучения ориентируются на библиотеку TensorFlow, которая предоставляет большой функционал для работы с GPU. Другой популярной библиотекой является PyTorch, которая также предлагает возможности работы с графическими процессорами.

Для использования графических процессоров в Python необходимо освоить базовые операции работы с видеокартами. Важно понять, какие задачи можно оптимизировать с помощью GPU, и какие требуют большую вычислительную мощности процессора. Также необходимо ознакомиться с техниками параллельных вычислений и оптимальной работой с памятью видеокарты.

После освоения базовых понятий и техник работы с графическими процессорами, можно приступить к их использованию для ускорения работы с машинным обучением. Возможности использования GPU в машинном обучении включают обучение нейронных сетей, вычисление оптимизационных задач, обработку изображений и многое другое.

Освоение работы с графическими процессорами в Python позволит значительно увеличить скорость обучения моделей машинного обучения и сократить время вычислений. Однако, необходимо учитывать, что не для всех задач графический процессор будет оптимальным выбором. Перед использованием GPU необходимо провести анализ задачи и оценить соотношение вычислительной мощности между процессором и видеокартой.

В заключение, освоение работы с графическими процессорами в Python предоставляет широкие возможности для ускорения работы с машинным обучением. Применение GPU позволяет существенно сократить время вычислений и значительно увеличить производительность.

Deep learning

Deep learning (глубокое обучение) — это подраздел машинного обучения, который использует алгоритмы обучения нейронных сетей для решения сложных задач. Один из самых популярных языков программирования для реализации алгоритмов глубокого обучения — это Python.

Python широко используется в сфере машинного обучения благодаря своей простоте и эффективности. Он предоставляет множество библиотек и фреймворков, которые облегчают процесс разработки и обучения моделей глубокого обучения.

Основным преимуществом использования графических процессоров (GPU) в глубоком обучении является ускорение обучения моделей. Так как алгоритмы глубокого обучения имеют сложную структуру и требуют большого количества вычислений, использование GPU позволяет значительно сократить время обучения моделей.

Для работы с графическими процессорами в Python существует несколько библиотек, таких как TensorFlow и PyTorch. Эти библиотеки позволяют легко интегрировать использование GPU в процесс обучения моделей глубокого обучения. Для использования GPU с помощью этих библиотек требуется освоение специальных инструкций и методов.

Изучение, как использовать графические процессоры в Python для машинного обучения, требует изучения основных понятий и принципов работы с GPU. Необходимо освоить различные операции и функции для работы с видеокартами, а также научиться эффективно использовать ресурсы этих видеокарт для ускорения обучения моделей глубокого обучения.

Начать изучение работы с графическими процессорами в Python можно с официальной документации библиотек TensorFlow и PyTorch. В документации представлены пошаговые инструкции и примеры кода, которые помогут освоить основы работы с графическими процессорами для машинного обучения.

Работа с графическими процессорами в Python для машинного обучения — это важный навык, который поможет вам улучшить эффективность и скорость разработки и обучения моделей глубокого обучения.